Две недели назад наша команда Gless AI заняла 2-е место среди 350+ команд на международном хакатоне Agentic Legal RAG Challenge 2026 и забрала приз $8 000. Мы должны были лететь в Дубай на конференцию Machines Can See в рамках Dubai AI Week, чтобы представить решение лично, но из-за обстановки не получилось — поэтому делимся итогами здесь.

Что это был за хакатон

Задача звучит просто: ответить на 900 юридических вопросов по корпусу из 300 PDF — судебные решения, законы, регламенты DIFC (Дубайский международный финансовый центр) — с обязательной ссылкой на конкретные страницы-источники.

На практике это была одна из самых жёстких метрик, которые мы видели в RAG-соревнованиях:

- Скоринг мультипликативный — слабые ссылки на источники (grounding) убивали весь результат, даже если ответы были правильные.

- Часть вопросов — ловушки: они ссылались на несуществующие дела или законы, и правильный ответ был «ничего не нашли». Уверенная галлюцинация стоила сразу нескольких компонент скора.

- Учитывалась скорость ответа: медленные пайплайны штрафовались отдельным множителем.

Иначе говоря, это был тест именно на production-grade: «красиво построенный медленный пайплайн» или «быстрый, но галлюцинирующий бот» проигрывали оба.

Финальный результат

В топ-5 команд разница была меньше шести пунктов:

- RAGnarok — 77.9

- Gless AI — 76.7

- CPBD — 76.0

- Cohomology — 72.0

- Dmitry Ulybin — 71.9

Полный leaderboard — на agentic-challenge.ai/leaderboard.

Почему это важно для бизнеса

Большинство RAG-систем, которые мы видим в продакшне, оптимизированы под одну метрику — «отвечает или нет». Этого недостаточно. В юридической, медицинской, финансовой работе любая ссылка должна быть проверяемой, а уверенный неправильный ответ хуже, чем «не нашёл».

Хакатон ровно об этом: там нельзя было выиграть ни медленным переусложнённым пайплайном, ни быстрым, но без точных ссылок. Сам факт, что мы взяли 2-е место среди 350+ команд, для нас важнее премии — это конкретное подтверждение, что мы умеем строить RAG, который выдерживает прод-нагрузку и проверки клиентов.

Что мы вынесли

Несколько коротких выводов, применимых к любому RAG-проекту, не только юридическому:

- Grounding — это не «фича», а ядро системы. Если пользователь не может ткнуть в страницу-источник, RAG в серьёзных доменах бесполезен.

- Простой пайплайн с правильными деталями обыгрывает «умных» агентов. На финальной фазе наши 600 строк Python обогнали SOTA-агента, который работал по той же задаче 1.5 часа.

- Замеряйте качество ответов, grounding и latency одновременно. Метрика по одному из них врёт — пайплайн, который красиво отвечает, но медленный или без ссылок, в проде не живёт.

Технические подробности

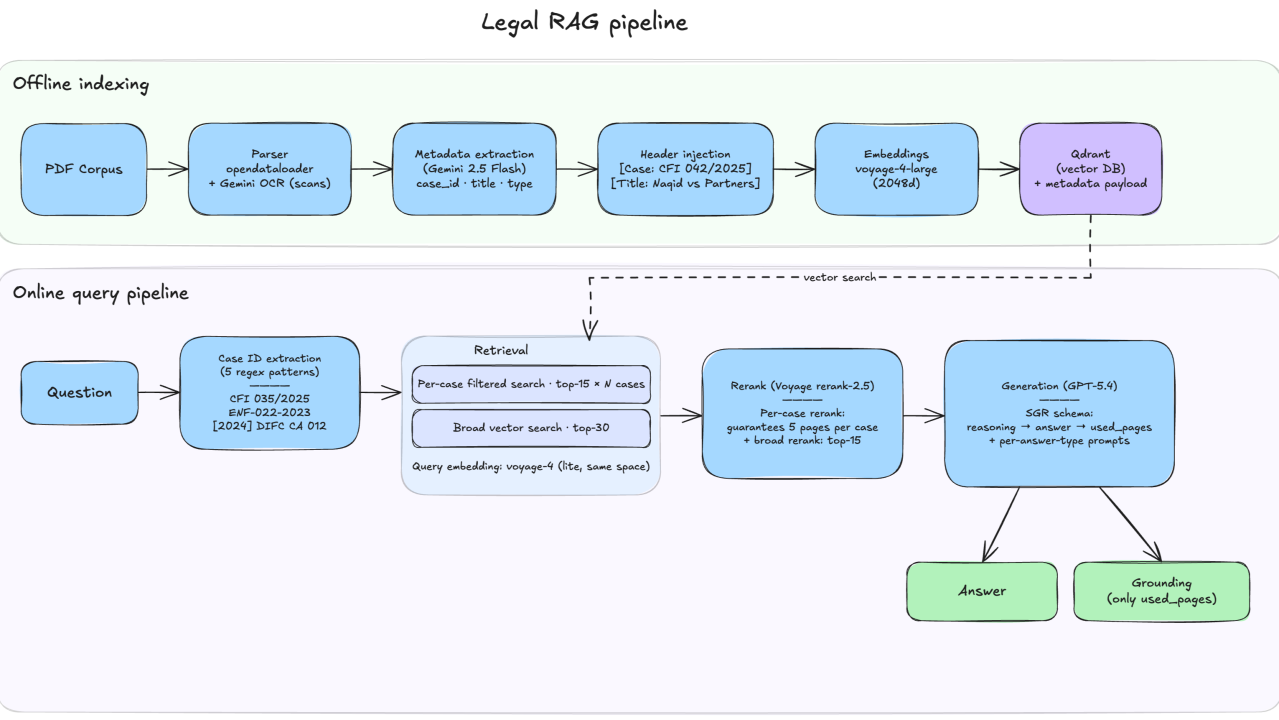

Если интересна вся техническая часть — парсинг, эмбеддинги, retrieval, ранжирование, structured output, что мы пробовали и от чего отказались — мы написали подробный технический разбор на LinkedIn.

Если вы строите RAG-систему, где цена ошибки — это репутация или регуляторика, напишите нам — поможем спроектировать пайплайн, в котором ссылки на источники работают, а пользователь верит ответам.